ZKML赋能:AI+Web3治理新范式?

AI与Web3的现状:失控的蜂群与熵增

还记得凯文·凯利在《失控》里提到的蜂群吗?它们通过一种分布式管理的方式,用群舞来决定大事。哪个群舞规模最大,蜂群就听谁的。就像墨利斯·梅特林克说的“蜂群的灵魂”——每只蜜蜂都能自己做决定,然后引导其他蜜蜂来证实,最终的决定是整个群体的选择。

熵增,这个听起来有点学术的词,其实就是说事物总是朝着无序的方向发展。就像把一群分子扔进一个空箱子里,它们会随机分布,而不是整整齐齐地排列。放到人身上,算法生成的人群虽然各有想法,但也会展现出群体规律,就像被关在一个箱子里,最后会达成某种共识。

当然,群体共识不一定是对的,但它代表了大多数人的意见。能拉起共识的意见领袖,那绝对是超级个体。但大多数时候,共识也不需要所有人完全同意,只要大家普遍认可就行。

我们不讨论AI会不会把人类带偏,这种讨论已经够多了。不管是AI生成的大量垃圾污染了网络数据的真实性,还是群体决策的失误导致一些事件走向更危险的境地。

AI目前的状况有点像天然的垄断。训练和部署大模型需要大量的计算资源和数据,只有少数企业和机构有这个实力。这些数据被垄断者视为珍宝,别说开源共享了,连互相接入都不可能。

这就造成了极大的数据浪费。每个大型AI项目都要重复收集用户数据,最后赢家通吃——要么被收购,要么做大做强,还是传统互联网圈地跑马的逻辑。

很多人说,AI和Web3是两回事,没有任何联系——前半句是对的,这是两个不同的赛道。但后半句就有问题了。利用分布式技术限制人工智能的垄断,以及利用人工智能技术促进去中心化共识机制的形成,简直是天作之合。

底层推演:让AI形成真正的分布式群体共识机制

人工智能的核心还是人。机器和模型不过是对人思维的揣测和模仿。群体实际上很难被抽象出来,因为我们每天看到的都是真实的个体。但模型就是利用海量的数据进行学习和调整,最后模拟出的群体形态。

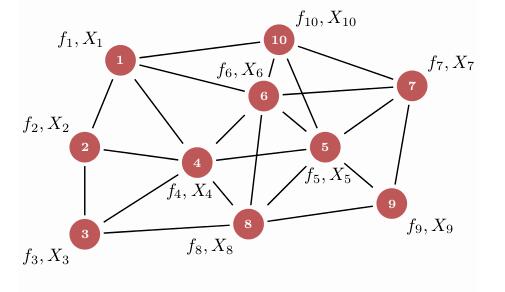

对于一个特定的DAO来说,如果把治理做到机制化,必然会影响效率,因为群体共识的形成本来就是一件麻烦事,更何况还要投票、统计等一系列操作。如果把DAO的治理以AI模型形式体现,所有的数据都来自于DAO内所有人的发言数据,那么输出的决策实际上会更接近于群体共识。

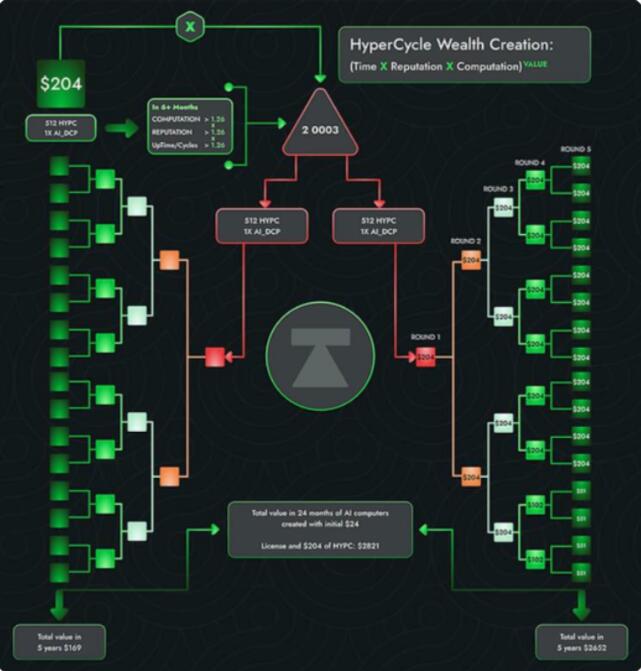

单个模型的群体共识可以按照上述方案进行训练,但对于这些个体来说,终究还是孤岛。如果集体智能系统形成群体AI,在这个系统中每个AI模型之间会相互协同工作,用来解决复杂问题,其实就对共识层面的赋能有了极大的作用。

对于小型集合,既可以自主搭建生态,也可以和其他集合形成配合集,更加高效低成本地满足超大型的算力或数据交易。但问题又来了,各个模型数据库之间的现状是完全不信任、防备着其他人的——这正是区块链的天然属性所在:通过去信任化,实现真正分布式的AI机器间安全高效互动。

一个全球性的智能大脑可以使得原本相互独立且功能单一的AI算法模型相互配合,在内部执行复杂的智能算法流程,就可以不断增长地形成分布式群体共识网络。这也是AI对Web3赋能的最大意义所在。

隐私与数据垄断?ZK与机器学习的结合

人类不论是对于AI作恶还是基于对隐私的保护、对数据垄断的畏惧,都要针对性地进行防范。而最核心的问题在于我们并不知道结论是如何得出的,同样的,模型的运营者也不打算对这个问题解惑答疑。而针对于上文中我们提到的全球性智能大脑的结合就更需要解决这个问题,不然没有数据方愿意拿出自己的核心去和别人共享。

ZKML(Zero Knowledge Machine Learning) 是将零知识证明用于机器学习的技术。零知识证明 (Zero-Knowledge Proofs,ZKP),即证明者(prover)有可能在不透露具体数据的情况下让验证者(verifier)相信数据的真实性。

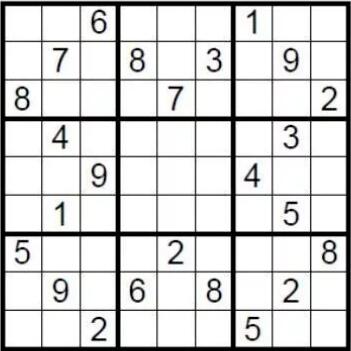

举个例子,有一个9×9的标准数独,完成条件是需要在九个九宫格里,填入1到9的数字,让每个数字在每个行、列及九宫格里都只能出现一次。那么布置这道谜题的人如何在不泄露谜底的情况下向挑战者证明该数独有解呢?

只需要在填充处用答案盖住,然后随机让挑战者抽取几行或者几列,把所有的数字打乱顺序然后验证是否都是一到九即可。这就是一个简单的零知识证明体现。零知识证明技术具有完备性,正确性和零知识性三个特点,即证明了结论又不需要透露任何细节。其技术来源更是可以体现简约性,在同态加密的背景下,验证难度要远远低于生成证明难度。

机器学习(Machine Learning)则是使用算法和模型来让计算机系统从数据中学习和改进。通过自动化的方式从经验中学习,可以使系统根据数据和模型自动进行预测、分类、聚类和优化等任务。机器学习的核心在于构建模型,这些模型可以从数据中学习并自动进行预测和决策。而这些模型的搭建构造通常需要三个关键要素:数据集、算法和模型评估。数据集是机器学习的基础,包含了用于训练和测试机器学习模型的数据样本。算法是机器学习模型的核心,定义了模型如何从数据中学习和预测。模型评估是机器学习的重要环节,用于评估模型的性能和准确性,并决定是否需要对模型进行优化和改进。

在传统的机器学习中,数据集通常需要被收集到一个中心化的地方进行训练,这意味着数据所有者必须将数据共享给第三方,这可能会导致数据泄露或隐私泄露的风险。而使用ZKML,数据所有者可以在不泄露数据的情况下,将数据集共享给其他人,这是通过使用零知识证明来实现的。

零知识证明运用于机器学习的赋能,效果应该是可以预见的,这就解决了困扰已久的隐私黑箱和数据垄断问题:项目方是否可以在不泄露用户数据输入或模型具体细节的情况下完成证明和验证,是否可以让每一个集合都能够共享自己的数据或者模型进行作用而不会泄露隐私数据?当然,目前的技术还早,实践肯定会有很多的问题存在,这并不妨碍我们畅想,并且已经有许多团队在进行开发。

这种状况会不会带来小型数据库对大型数据库的白嫖呢?当你考虑到治理问题的时候,就又回到我们Web3的思维中了,Crypto的精髓在于治理。不论是通过大量的运用或者是共享都应该获得应有的激励。不论是通过原有的Pow、PoS机制还是最新出现的各种PoR(声誉证明机制),都是在为激励效果提供保证。

分布式算力:谎言与现实交织的创新叙事

去中心化算力网络一直是加密圈热门提到的一个场景,毕竟AI大模型需要的算力惊人,而中心化的算力网络不单会造成资源浪费还会形成实质上的垄断——如果比到最后拼的就是GPU的数量,那未免太没有意思了。

去中心化算力网络,实质是将分散在不同地点、不同设备上的计算资源整合起来。大家常提的主要优势都有:提供分布式计算能力、解决隐私问题、增强人工智能模型的可信度和可靠性、支持各种应用场景下的快速部署和运行,以及提供去中心化的数据存储和管理方案。没错,通过去中心化算力,任何人都可以运行AI模型,并在来自全球用户的真实链上数据集上进行测试,这样就可以享受到更加灵活、高效、低成本的计算服务。

同时,去中心化算力可以通过创建一个强大的框架来解决隐私问题,保护用户数据的安全和隐私。并且提供透明、可验证的计算过程,增强人工智能模型的可信度和可靠性,为各种应用场景下的快速部署和运行提供灵活、可扩展的计算资源。

我们从一套完整的中心化算力流程来看模型训练,步骤通常会分为:数据准备、数据分割、设备间数据传输、并行训练、梯度聚合、参数更新、同步,再到重复训练。在这个过程当中,即便是中心化机房使用高性能的计算设备集群,通过高速网络连接共享计算任务,高昂的通信成本也成为了去中心化算力网络的最大限制之一。

因此,尽管去中心化算力网络具有很多优势和潜力,但依照目前的通信成本和实际运行难度来看发展道路仍然曲折。在实践中,实现去中心化算力网络需要克服很多实际的技术问题,不论是如何确保节点的可靠性和安全性、如何有效地管理和调度分散的计算资源,还是如何实现高效的数据传输和通信等等,恐怕都是实际面临的大问题。

留给理想主义者的期待

回到现实,AI与Web3深度结合的叙事虽然美好,但资本和用户似乎并不买账。除非项目方能像OpenAI一样,在自身强大的同时抱住一个强有力的金主,否则深不见底的研发费用和尚不清晰的商业模式将把我们彻底击垮。

无论是AI还是Web3,现在都处于极为早期的发展阶段,就像上世纪末的互联网泡沫,一直到近十年之后才正式迎来真正的黄金时期。麦卡锡曾幻想在一个假期之内设计出具有人类智力的人工智能,但直到近七十年后我们才真正迈开人工智能的关键一步。

Web3+AI也同样如此,我们已经确定了前进方向的正确性,剩下的便交给时间。

当时间的潮水逐渐褪去,那些屹立不倒的人和物,便是我们由科幻通向现实的基石。

热门优惠券

更多-

- ROTHSCROOSTER旗舰店满49减16

- 有效期至: 2025-01-25

- 立即领取

-

- 萨布森旗舰店满1299减800

- 有效期至: 2025-01-17

- 立即领取

-

- 哲高玩具旗舰店满69减33

- 有效期至: 2025-01-05

- 立即领取

-

- 戴·可·思官方旗舰店满196减27

- 有效期至: 2025-04-01

- 立即领取

-

- 佳婴旗舰店满30减3

- 有效期至: 2025-01-10

- 立即领取

-

- ROTHSCROOSTER旗舰店满19减8

- 有效期至: 2025-01-25

- 立即领取

-

- 荣业官方旗舰店满20减10

- 有效期至: 2025-01-04

- 立即领取

-

- 戴·可·思(Dexter)母婴京东自营旗舰店满48减10

- 有效期至: 2025-01-12

- 立即领取

-

- KOKOROCARE旗舰店满158减100

- 有效期至: 2025-03-28

- 立即领取

-

- RODEL官方旗舰店满59减30

- 有效期至: 2025-01-02

- 立即领取