突发!小米开源MiMo大模型,性能超越OpenAI

前脚阿里刚开源超强的混合推理模型Qwen3,后脚小米也来放了个大招!

小米公司正式发布并宣布开源其首个专注于提升模型推理(Reasoning)能力的大型语言模型Xiaomi MiMo。这款模型旨在通过技术创新,突破现有预训练模型的潜在瓶颈,深度激发AI的思考与解决问题能力。

小米方面表示,开发MiMo的核心出发点在于探索如何在当前大模型技术基础上,有效提升其进行复杂逻辑推理、数学运算和代码生成等高级认知任务的能力。通过联动预训练与后训练阶段的优化,MiMo力求在推理性能上实现显著飞跃。

基准测试表现突出:7B模型超越更大竞争对手

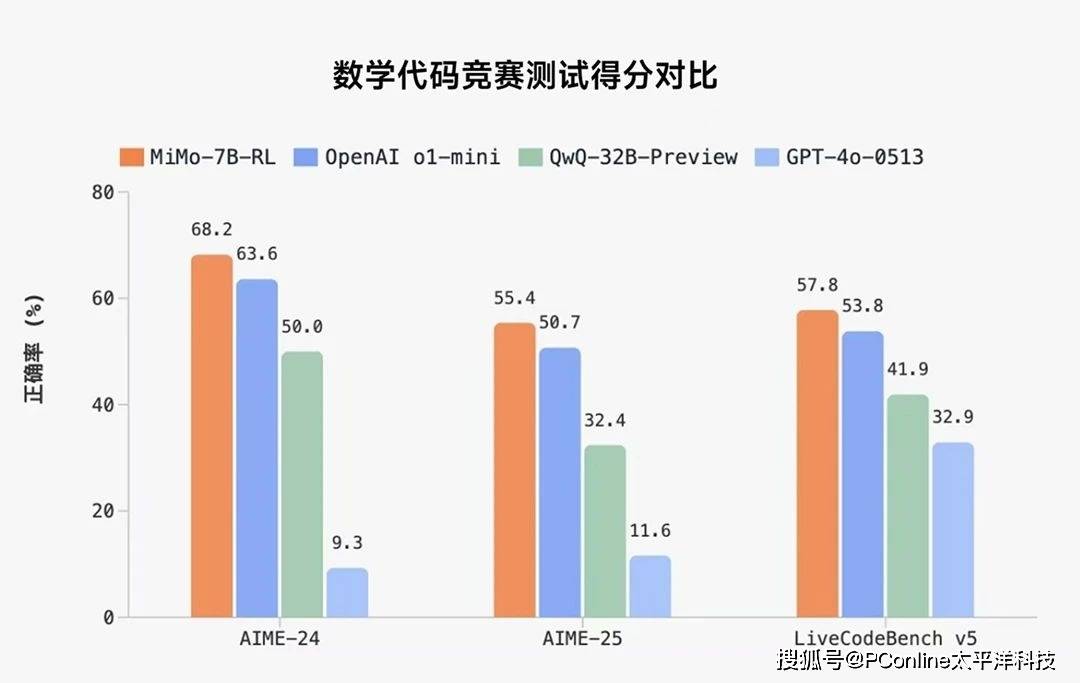

根据小米公布的测试数据,Xiaomi MiMo在多个衡量模型推理能力的公开基准测试中展现出超越同类甚至更大规模模型的优异性能。

在考察数学推理水平的AIME 24-25评测集和评估代码竞赛能力的LiveCodeBench v5评测集上,参数规模为7B的MiMo模型,其表现均超过了OpenAI的闭源推理模型o1-mini,以及参数量高达32B的阿里开源推理模型QwQ-32B-Preview。这一结果表明,MiMo在推理效率和效果上达到了行业领先水平。

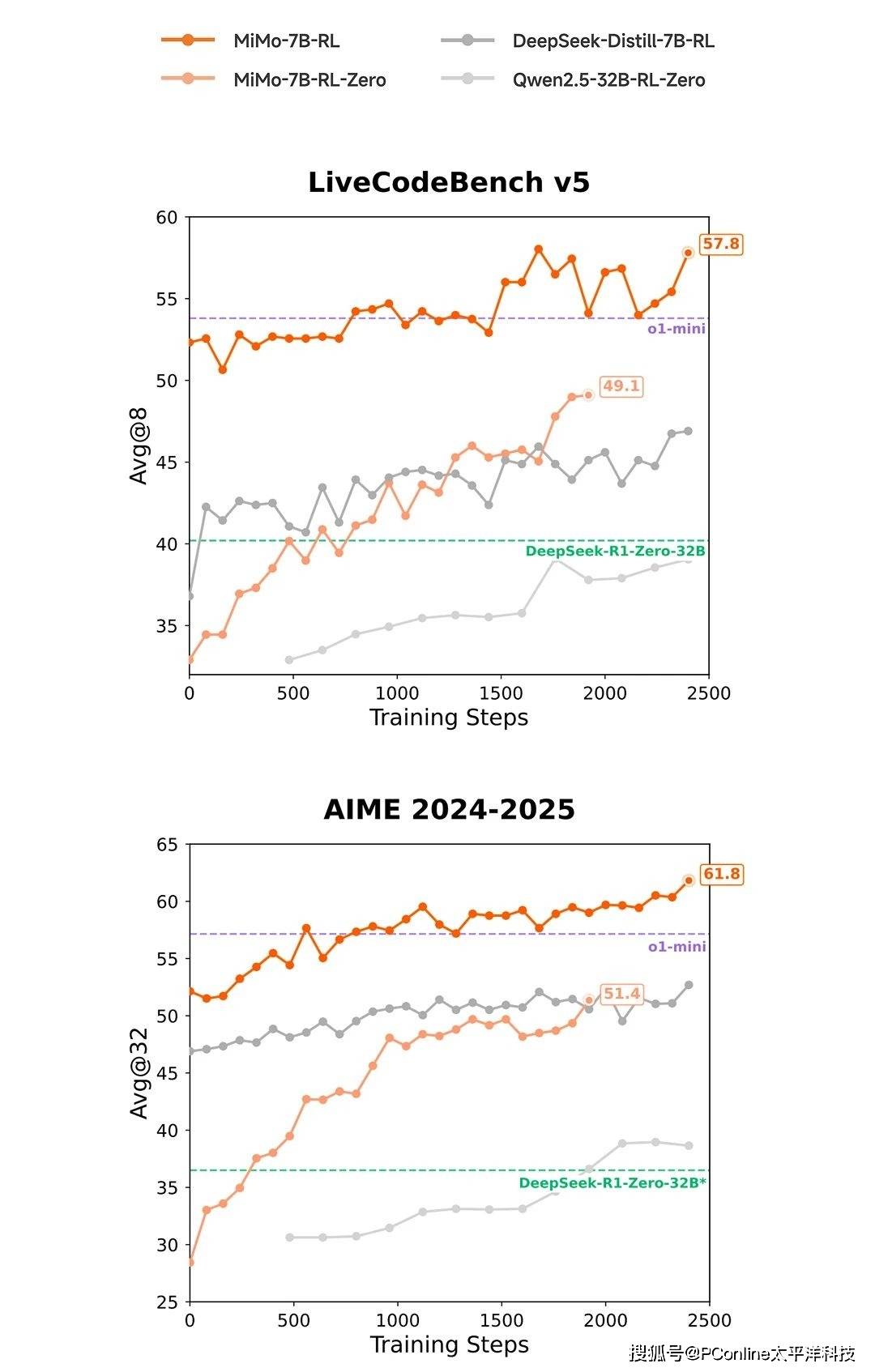

此外,研究显示MiMo-7B在强化学习(RL)领域展现出显著的潜力优势。与当前业内广泛用作RL起始模型的DeepSeek-R1-Distill-7B和Qwen2.5-32B(32B参数)相比,即使在相同RL数据条件下进行训练,MiMo-7B在数学与代码领域的RL潜力评估中依然表现更优。

技术解析:预训练与后训练的协同创新

MiMo之所以能在推理能力上取得突破,得益于小米大模型Core团队在模型设计与训练流程上的多项技术创新:

预训练阶段:强化推理模式学习。 团队在预训练数据上着重挖掘富推理语料,并创新性地合成了约200B tokens的高质量推理数据,让模型充分接触并学习各种推理逻辑。训练过程采用三阶段训练模式,逐步提升难度,累计训练数据量达到25T tokens。

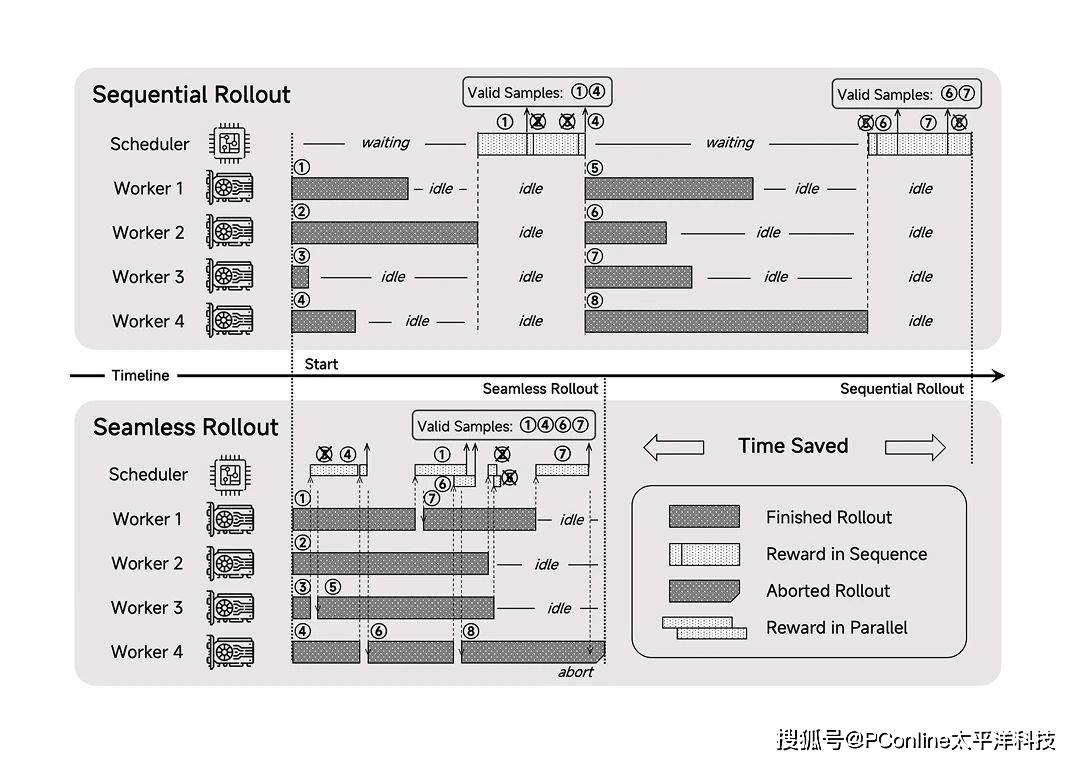

后训练阶段:构建高效稳定强化学习系统。 在此阶段,小米团队引入了创新的RL算法和框架。算法层面,提出了Test Difficulty Driven Reward机制,旨在缓解困难推理问题中的奖励稀疏性,并引入Easy Data Re-Sampling策略以提高训练稳定性。框架层面,通过设计的Seamless Rollout系统,显著提升了RL训练效率(加速 2.29 倍)和验证效率(加速 1.96 倍)。

上述技术细节已在小米公开的技术报告中详细阐述。

小米大模型Core团队首个重要对外成果

为推动人工智能社区在推理能力方向的共同发展,小米已将Xiaomi MiMo-7B的四个变体模型全部开源,托管于HuggingFace平台。全球的开发者和研究人员现可免费获取并使用这些模型。

据了解,Xiaomi MiMo是小米新近成立的「小米大模型Core团队」的首个重要对外成果。该团队表示,尽管当前大模型技术发展迅速,但实现通用人工智能(AGI)仍然是一个长期的目标与挑战。团队将持续秉持务实创新的精神,探索人工智能的前沿领域,致力于通过技术突破不断拓展智能的边界。

小米模型这么强,能不能让小爱同学厉害点啊?

热门优惠券

更多-

- ROTHSCROOSTER旗舰店满49减16

- 有效期至: 2025-01-25

- 立即领取

-

- 萨布森旗舰店满1299减800

- 有效期至: 2025-01-17

- 立即领取

-

- 哲高玩具旗舰店满69减33

- 有效期至: 2025-01-05

- 立即领取

-

- 戴·可·思官方旗舰店满196减27

- 有效期至: 2025-04-01

- 立即领取

-

- 佳婴旗舰店满30减3

- 有效期至: 2025-01-10

- 立即领取

-

- ROTHSCROOSTER旗舰店满19减8

- 有效期至: 2025-01-25

- 立即领取

-

- 荣业官方旗舰店满20减10

- 有效期至: 2025-01-04

- 立即领取

-

- 戴·可·思(Dexter)母婴京东自营旗舰店满48减10

- 有效期至: 2025-01-12

- 立即领取

-

- KOKOROCARE旗舰店满158减100

- 有效期至: 2025-03-28

- 立即领取

-

- RODEL官方旗舰店满59减30

- 有效期至: 2025-01-02

- 立即领取